Postagens

O que é MCP? O model context protocol explicado para times ágeis

Kelly Lewandowski

Última atualização 27/04/20269 min de leitura

O que o MCP é de fato

Servidor MCP

Cliente MCP

Tool

retro_create_item, planning_poker_cast_vote ou

standup_submit_answers.Recurso

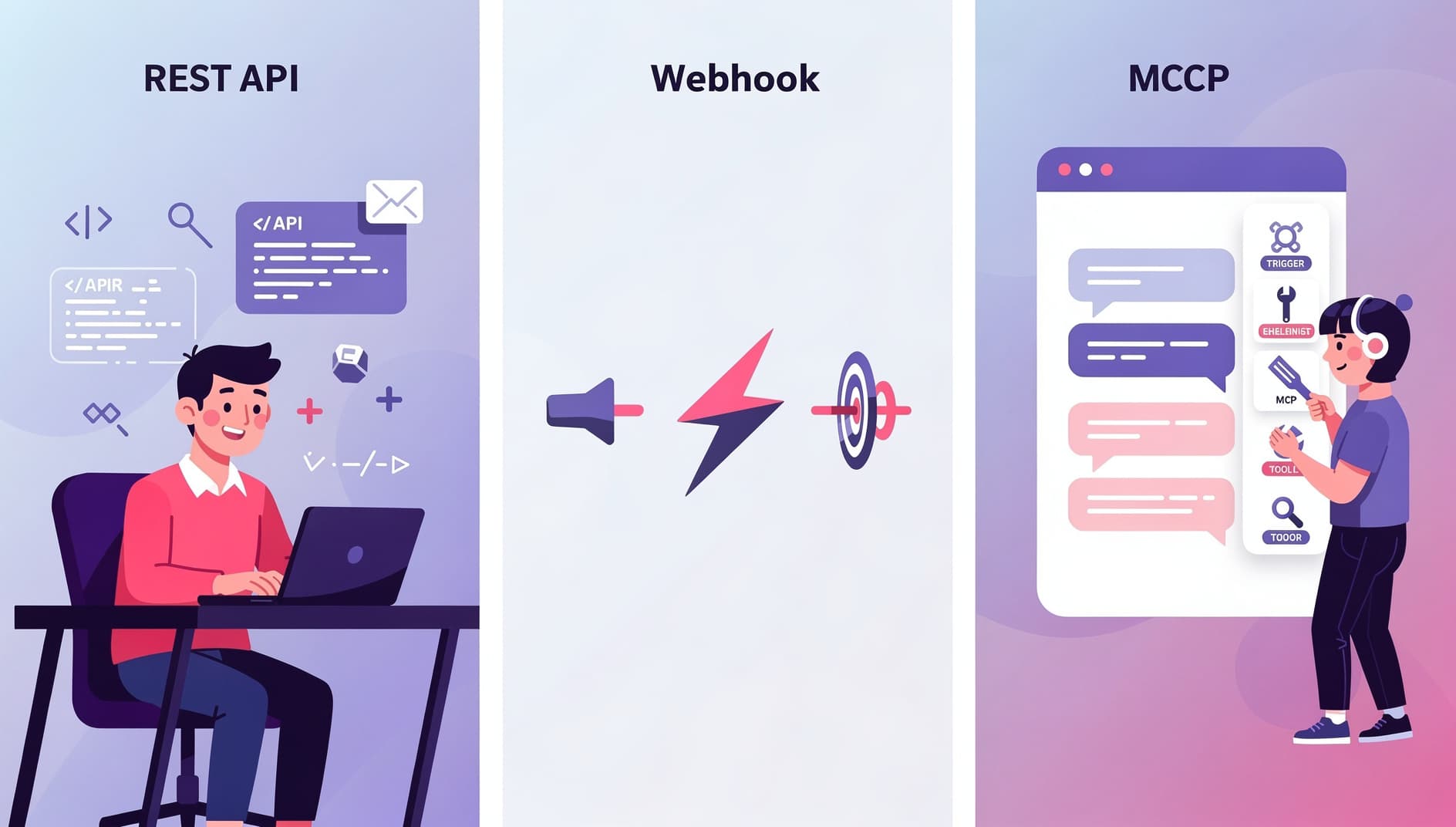

Como o MCP é diferente de uma REST API ou de um webhook

| Aspecto | REST API | Webhook | MCP |

|---|---|---|---|

| Direção | Você chama | Ele chama você | O modelo chama em seu nome |

| Quem escreve a integração | Um dev, com antecedência | Um dev, com antecedência | O modelo, em tempo de execução, a partir de uma lista de tools |

| Descoberta | Ler a documentação | Ler a documentação | O servidor retorna uma lista tipada de tools |

| Modelo de auth | API keys, OAuth | Payloads assinados | OAuth 2.1 + PKCE + Dynamic Client Registration |

| Melhor para | Apps e scripts | Reagir a eventos | Fluxos conversacionais e de agentes |

O fluxo de auth: OAuth 2.1, PKCE e DCR em português claro

Dynamic Client Registration (DCR, RFC 7591)

O OAuth tradicional exigia que cada cliente fosse pré-registrado na mão: um dev entra no painel de admin do SaaS, preenche um formulário, copia um client ID e secret, e cola em algum lugar. Isso não escala quando "o cliente" é toda instalação do Claude no mundo. O DCR deixa o cliente MCP se apresentar ao servidor de forma programática ("Sou o Claude Desktop no laptop deste usuário, aqui está a minha redirect URI") e o servidor devolve um client ID novo. Sem envolvimento de admin. Fluxo authorization code do OAuth 2.1

Uma vez com um client ID, o assistente abre seu navegador, redireciona para a página de login do provedor SaaS e pede que você aprove a conexão. É o mesmo fluxo que você usa no "Sign in with Google" em um site de terceiros. Você vê exatamente qual organização está conectando e quais escopos (leitura, escrita) o assistente está pedindo. O provedor SaaS devolve um authorization code, que o cliente troca por um access token. PKCE (Proof Key for Code Exchange)

O PKCE impede que o authorization code seja roubado no meio do caminho. O cliente gera um secret de uso único, faz um hash com SHA-256 e envia o hash logo no início. Quando ele depois resgata o code, precisa enviar o secret original. Um atacante que intercepta o code não consegue resgatá-lo sem aquele secret. A spec do MCP exige PKCE com o método S256, sem fallback para variantes mais fracas.Resource indicators (RFC 8707)

A spec do MCP de 2026 também exige que o cliente nomeie o servidor específico que ele pretende chamar quando solicita um token. Isso evita que um token emitido para um servidor MCP seja replayed contra outro. O token fica vinculado a uma única audience.

Por que times ágeis em particular deveriam se importar

🌅Standups que se escrevem sozinhos

🃏Planning poker direto do backlog

🪞Retros pré-populadas com dados reais

✅Action items com contexto

O que dá para fazer hoje, na prática